Kubernetes部署流程文件详解

Kubernetes,简称K8s,源自Google在2014年开源的容器编排项目。在Google庞大的内部系统Borg的基础上发展起来,旨在简化容器化应用的部署、扩展和管理。随着微服务架构的兴起,Kubernetes逐渐成为业界标准的容器编排工具,被广泛应用于自动化部署、扩展和管理容器化应用程序的开源系统。Kubernetes集群由Master节点和Worker节点组成。

简介:Kubernetes(k8s)是自动化容器化应用部署、扩展和管理的关键平台。本文关注于k8s部署过程中的关键文件,包括”cri-dockerd”容器运行时接口的实现,用于k8s与Docker等容器引擎的通信;”runc.amd64”作为OCI标准的容器执行工具;以及” kube-flannel.yml”文件,用于配置k8s集群内的网络连接。本文将详细阐述这些文件的作用及其在k8s部署中的重要性。

1. Kubernetes简介与部署

1.1 Kubernetes的起源与概念

1.1.1 Kubernetes的诞生背景

Kubernetes,简称K8s,源自Google在2014年开源的容器编排项目。在Google庞大的内部系统Borg的基础上发展起来,旨在简化容器化应用的部署、扩展和管理。随着微服务架构的兴起,Kubernetes逐渐成为业界标准的容器编排工具,被广泛应用于自动化部署、扩展和管理容器化应用程序的开源系统。

1.1.2 Kubernetes的核心组件介绍

Kubernetes集群由Master节点和Worker节点组成。Master节点负责整个集群的管理,主要组件包括API Server、Scheduler、Controller Manager和etcd。而Worker节点主要运行Pods,每个Pod是应用的最小部署单位,可能包含一个或多个容器。核心组件之外,Kubernetes还包括了服务发现和负载均衡、存储编排、自动部署、自我修复等能力。

1.1.3 Kubernetes的基本概念和术语

在Kubernetes的世界里,用户会遇到Pods、Services、Deployments、Namespaces、Volumes等概念。Pod是运行在集群中的一个或多个容器的组合。Service为一组功能相同的Pod提供一个固定的入口。Deployment声明了Pods的期望状态,负责Pod的创建与更新。Namespace用来隔离资源,而Volume则用于持久化存储数据。通过这些基本概念和术语,Kubernetes实现了容器编排的自动化。

接下来,在后续小节中,我们将探讨Kubernetes的部署准备工作,并详细介绍部署过程。

2. cri-dockerd的作用与部署

在 Kubernetes 的生态中,容器运行时(Container Runtime)是关键组件之一,负责运行容器。cri-dockerd 是一个实现 Kubernetes Container Runtime Interface (CRI) 的守护进程,它允许 Kubernetes 通过 CRI 接口与 Docker 引擎交互。本章将探讨 cri-dockerd 的概念、部署步骤以及在 Kubernetes 中的应用。

2.1 cri-dockerd概述

2.1.1 什么是cri-dockerd

cri-dockerd 是 Docker 社区提供的一款轻量级的守护进程,它实现了 Kubernetes CRI 的部分接口。CRI 是 Kubernetes 为了标准化容器运行时的接口而设计的一套 API,这样 Kubernetes 就可以支持除了 Docker 之外的其他容器运行时,比如 containerd、CRI-O 等。cri-dockerd 允许 Kubernetes 集群使用最新的 Docker 版本,同时保持与 Kubernetes 的兼容性。

2.1.2 cri-dockerd与容器运行时的关系

在 Kubernetes 环境中,容器运行时是负责容器生命周期管理的组件。cri-dockerd 充当了 Docker 引擎和 Kubernetes 集群之间的桥梁。当 Kubernetes 需要创建、启动、停止容器时,它会通过 CRI 接口将请求发送给 cri-dockerd,后者再与 Docker 引擎进行通信,完成相应的容器操作。这样的设计使得 Docker 引擎的更新不会影响到 Kubernetes 集群的稳定性。

2.2 cri-dockerd的安装部署

2.2.1 下载和安装cri-dockerd

在安装 cri-dockerd 之前,需要确保系统中已安装 Docker 社区版或企业版。以下是下载和安装 cri-dockerd 的基本步骤:

- 从 GitHub 发布页面下载与你的 Docker 版本相对应的 cri-dockerd。

- 解压下载的包到一个目录,例如

/usr/local。 - 将

cri-dockerd的执行文件路径添加到环境变量 PATH 中。 - 启动 cri-dockerd 服务。

具体命令如下:

# 下载并解压

curl -LO https://github.com/Mirantis/cri-dockerd/releases/download/<version>/cri-dockerd-amd64.tar.gz

tar -zxvf cri-dockerd-amd64.tar.gz

# 移动文件到合适的位置并命名

sudo mv cri-dockerd /usr/local/bin/

# 创建一个服务文件

sudo vim /etc/systemd/system/cri-docker.service

# 在服务文件中添加以下内容:

[Unit]

Description=cri-dockerd

Documentation=https://docs.docker.com

After=network-online.target firewalld.service

Wants=network-online.target

[Service]

Type=notify

ExecStart=/usr/local/bin/cri-dockerd

Restart=always

RestartSec=5

LimitNOFILE=infinity

LimitNPROC=infinity

LimitCORE=infinity

Delegate=yes

KillMode=process

TimeoutStartSec=0

[Install]

WantedBy=multi-user.target

# 重新加载并启动服务

sudo systemctl daemon-reload

sudo systemctl enable --now cri-docker.service

2.2.2 配置cri-dockerd支持的容器运行时

cri-dockerd 默认配置即可支持 Docker 容器运行时,无需额外配置。然而,在某些情况下,可能需要调整 cri-dockerd 的配置文件(cri-dockerd-config.json),以便更好地适应特定的部署需求。这个配置文件可能包含 Docker 引擎的配置项,以及 cri-dockerd 自身的配置。

2.2.3 验证cri-dockerd的安装和运行状态

安装完成后,可以使用以下命令检查 cri-dockerd 的运行状态:

systemctl status cri-docker.service

此外,可以通过以下命令验证 cri-dockerd 是否正常工作:

crictl info

如果输出的信息中包含版本信息,说明 cri-dockerd 已成功与 Kubernetes 集群集成。

2.3 cri-dockerd在Kubernetes中的应用

2.3.1 配置Kubernetes使用cri-dockerd

为了使 Kubernetes 使用 cri-dockerd 作为容器运行时,需要修改 kubelet 的配置文件。以下是配置的示例:

# kubelet-config.yaml

kind: KubeletConfiguration

apiVersion: kubelet.config.k8s.io/v1beta1

containerRuntime: remote

containerRuntimeEndpoint: unix:///run/cri-dockerd.sock

接下来,重启 kubelet 服务:

systemctl restart kubelet.service

2.3.2 监控和管理cri-dockerd性能

监控 cri-dockerd 的性能是确保 Kubernetes 稳定运行的关键步骤之一。可以使用内置的 crictl 工具来监控容器和节点的状态。此外,通过集成 Prometheus 和 Grafana 等监控工具,可以实现对 cri-dockerd 运行状态的实时监控。

2.3.3 常见问题的诊断与解决

在使用 cri-dockerd 过程中,可能会遇到一些问题。以下是一些常见问题的诊断与解决方法:

- 如果

crictl info命令显示containerd作为容器运行时,需要检查 kubelet 的配置文件,并确保已正确配置containerRuntimeEndpoint指向 cri-dockerd。 - 如果遇到节点状态异常,可检查 Docker 和 cri-dockerd 的日志文件,通常位于

/var/log/docker.log和/var/log/cri-dockerd.log。

通过上述步骤,可以确保 cri-dockerd 在 Kubernetes 环境中顺利部署和运行。这样,Docker 容器运行时就能与 Kubernetes 集群协同工作,为应用提供一个稳定、高效的运行环境。

3. runc.amd64的作用与部署

3.1 runc.amd64的角色与功能

3.1.1 runc.amd64作为容器运行时的意义

在Kubernetes生态系统中,容器运行时是实现容器化应用的关键组件。runc.amd64作为一种轻量级的容器运行时,与传统的虚拟化技术相比,提供了更快速的启动时间和更低的资源占用。作为Open Container Initiative (OCI) 容器运行时规范的实现,runc.amd64不仅允许开发者和运维人员部署与管理容器,而且确保了与平台无关的容器标准化。它简化了容器的打包、分发和运行过程,让应用开发和部署更加敏捷和高效。

3.1.2 runc.amd64的架构与实现原理

runc.amd64的工作原理基于Linux的cgroups和namespaces技术,提供了一个符合OCI标准的容器运行时环境。其架构允许它作为独立工具运行,也可以被集成到更高级别的容器管理工具中,如Docker和Kubernetes。runc.amd64的核心是一个命令行界面,它接受启动、停止、删除和其它与容器生命周期相关的命令。在启动容器时,runc.amd64会创建一个新的进程,并将应用的根文件系统、运行环境和网络配置等封装到该进程中。利用cgroups进行资源限制,namespaces实现隔离,确保容器在隔离环境中运行,避免互相干扰。

3.2 runc.amd64的安装与配置

3.2.1 获取和安装runc.amd64

在AMD64架构的服务器上,获取和安装runc.amd64非常直接。以下是安装步骤的概览:

- 首先,您需要下载适合您操作系统的runc.amd64二进制文件。

- 将下载的文件放置到系统路径中的某个目录,如

/usr/local/bin/。 - 通过运行

runc.amd64 --version确认安装成功。

示例安装脚本:

# 下载runc.amd64

wget https://github.com/opencontainers/runc/releases/download/v1.0.0-rc10/runc.amd64

# 使runc.amd64可执行并安装到/usr/local/bin/

chmod +x runc.amd64

sudo mv runc.amd64 /usr/local/bin/

# 测试安装

runc.amd64 --version

3.2.2 配置runc.amd64与Kubernetes集成

要让Kubernetes使用runc.amd64作为容器运行时,需要做相应的配置:

- 配置Kubelet进程以使用runc.amd64作为默认容器运行时。

- 确保runc.amd64已经安装在所有工作节点上。

- 配置适当的权限和安全设置,以使Kubelet可以与runc.amd64正常通信。

Kubelet配置修改示例:

kind: KubeletConfiguration

apiVersion: kubelet.config.k8s.io/v1beta1

containerRuntime: remote

containerRuntimeEndpoint: "unix:///var/run/cri-dockerd.sock"

3.2.3 runc.amd64的安全性和权限管理

runc.amd64的安全性依赖于Linux内核的安全特性,如AppArmor和SELinux。在部署时,根据企业的安全策略,管理员需要配置和应用相应的安全策略。

- AppArmor : 通过定义安全策略文件来限制容器的能力。

- SELinux : 标记和控制容器进程的安全上下文。

管理员可以使用以下命令设置runc.amd64的安全配置:

# 设置AppArmor策略

aa-status

aa-enforce /etc/apparmor.d/profile.container

# 设置SELinux上下文

chcon -t container_file_t /path/to/container/files

3.3 runc.amd64与Kubernetes集群的协同工作

3.3.1 runc.amd64在Pod生命周期中的作用

runc.amd64负责在Pod中创建和管理单个容器的生命周期。当Kubernetes调度一个Pod到节点上时,Kubelet将与runc.amd64交互,以启动容器。runc.amd64管理容器的运行,包括资源限制、网络配置和存储挂载等。在Pod生命周期结束时,Kubelet会通知runc.amd64终止容器进程,并清理容器环境。

3.3.2 监控和调试runc.amd64容器实例

对runc.amd64容器实例进行监控和调试,可以帮助运维人员快速定位和解决问题。常见的监控和调试工具包括 docker stats 、 ctr 、 crictl 等。这些工具可以提供容器的CPU、内存、I/O使用情况,以及日志输出等信息。

# 查看所有容器的资源使用情况

docker stats $(docker ps -q)

# 使用ctr获取容器的详细信息

ctr -n k8s.io c ls

3.3.3 runc.amd64的性能优化策略

优化runc.amd64的性能,可以提高整体集群的运行效率。性能优化的几个关键点包括:

- 资源限制 : 确保为容器正确设置CPU和内存限制,避免资源竞争。

- 使用overlayfs : 对于存储,overlayfs是一种有效的联合文件系统,它可以在不同层之间共享文件,并优化存储空间的使用。

- 优化cgroups : 调整cgroups参数来优化资源分配。

# 调整cgroups中的memory和cpu参数

echo "2097152" > /sys/fs/cgroup/memory/kubepods/memory.limit_in_bytes

echo "1024" > /sys/fs/cgroup/cpu/kubepods/cpu.cfs_period_us

echo "512" > /sys/fs/cgroup/cpu/kubepods/cpu.cfs_quota_us

通过这样的配置和优化,runc.amd64可以在保证高效率的同时,提供稳定可靠的容器运行环境。

4. kube-flannel.yml网络配置与部署

4.1 kube-flannel.yml网络模型解析

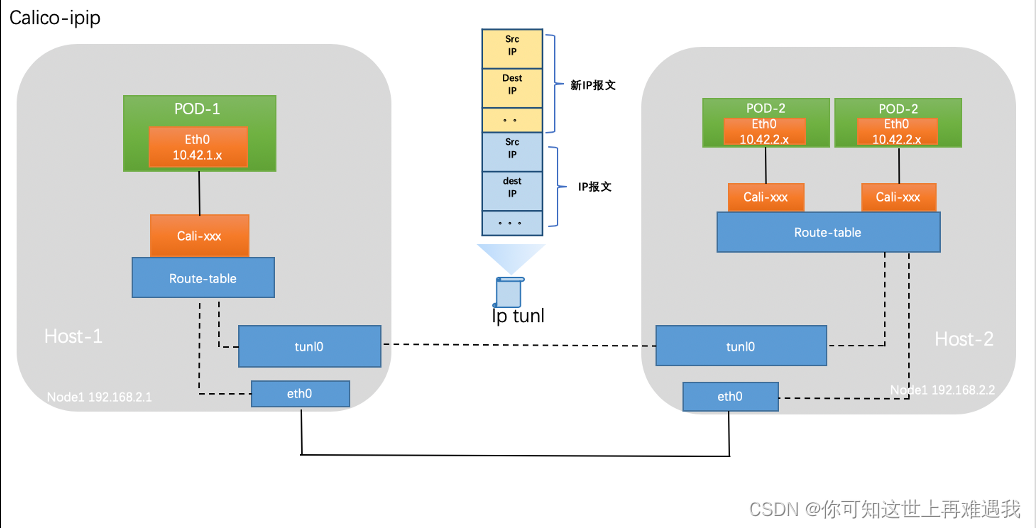

4.1.1 Kubernetes网络模型概述

Kubernetes 网络模型是设计来满足多租户环境下的容器通信需求的。在 Kubernetes 集群中,所有的 Pod 都应当能够跨节点进行通信。这意味着无论 Pod 被调度到哪个节点上,它都能够与其他所有 Pod 通信,无需使用 NAT(网络地址转换)。网络模型遵循几个核心原则:所有 Pod 都在同一个扁平化的地址空间中,每个 Pod 拥有一个 IP 地址,Pod 内部的容器共享这个 IP 地址,并且可以直接通过 IP 地址访问其他 Pod。

4.1.2 Flannel的工作原理和优势

Flannel 是 Kubernetes 中最常用的网络解决方案之一,它通过不同的后端实现为每个节点创建一个子网,从而为每个 Pod 分配 IP 地址。Flannel 常用的后端包括 VXLAN、host-gw 和 UDP 等。VXLAN 后端使用封装技术将二层数据包封装在三层进行传输,而 host-gw 后端则直接使用节点作为路由,通常能够提供更好的性能。Flannel 的优势在于它的简单性以及对跨节点通信的良好支持。

4.1.3 kube-flannel.yml文件结构和配置项

kube-flannel.yml 文件是一个 Kubernetes 配置清单,用于部署 Flannel 网络插件。该文件包含了多个资源对象,如 DaemonSet、ServiceAccount 和 ClusterRole 等。其中,DaemonSet 确保每个节点上都运行有一个 flannel 的 Pod 实例,ServiceAccount 是 Pod 执行集群操作的凭据,ClusterRole 及其绑定定义了权限范围。配置项包括了网络的子网范围、后端类型和相关的配置参数。

4.2 kube-flannel.yml的部署步骤

4.2.1 准备部署所需的yaml文件

部署 Flannel 的第一步是准备所需的 yaml 文件。通常,这包括一个主配置文件 kube-flannel.yml 。可以从 Kubernetes 官方仓库或 Flannel 项目的 GitHub 仓库获取该文件。例如:

curl -sSL https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml -o kube-flannel.yml

下载完成后,应该根据实际的网络要求和环境参数对 kube-flannel.yml 文件进行必要的编辑和定制。

4.2.2 应用kube-flannel.yml配置

一旦配置文件准备好并且已经根据集群的要求进行了自定义,就可以使用 kubectl 工具来应用这个配置文件,从而在集群中部署 Flannel:

kubectl apply -f kube-flannel.yml

这条命令会让 Kubernetes API 服务器创建和配置所需的资源对象,以确保 Flannel 能够正常运行在集群上。

4.2.3 验证网络配置和集群连通性

部署完成后,需要验证 Flannel 是否正确配置并能确保 Pod 间的网络连通性。可以通过检查 Pod 状态和运行状态来确认 Flannel 正常运行:

kubectl get pods --all-namespaces -l app=flannel

然后,创建一个简单的测试 Pod,比如一个 busybox Pod,来检查跨节点通信是否正常:

kubectl run busybox --image=busybox -n kube-system -it --restart=Never --rm -- bin/sh

在容器内部,你可以使用 ping 命令测试与其他节点上的 Pod 的连通性,确认网络是否按照预期工作。

4.3 kube-flannel.yml的维护与优化

4.3.1 监控Flannel网络性能

监控 Flannel 网络性能可以通过集成监控工具如 Prometheus 和 Grafana 来实现。通常情况下,Flannel 自带的指标就已经足够用于基本的性能监控,而 Kubernetes 集群的控制面板组件如 kube-state-metrics 和 Prometheus Operator 可以帮助进一步分析和可视化性能数据。

4.3.2 调整Flannel配置以适应业务需求

在特定的业务场景中,可能需要对 Flannel 的默认配置进行调整,以满足特定的性能或功能需求。例如,在需要较高网络性能的场景下,可能会选择 host-gw 作为后端。而在资源受限的环境中,使用 UDP 后端可能更合适。配置调整可以通过编辑部署的 DaemonSet 来实现,修改对应的 kube-flannel.yml 文件并重新部署。

4.3.3 故障排查与网络问题处理

当遇到网络问题时,首先应该查看 Flannel Pod 的日志和事件,以及检查节点上的网络接口和服务状态。此外,可以使用 flanneld 的调试工具和 etcdctl 来检查 flannel 的后端存储状态。对于更复杂的网络问题,可能需要深入分析 Flannel 的数据包封装和解封装过程,或者检查底层网络设备和配置。

通过上述章节的介绍,我们已经全面了解了使用 kube-flannel.yml 来部署和配置 Kubernetes 网络的各个方面。接下来,我们将探讨 Kubernetes 文件系统的管理和优化。

5. Kubernetes文件系统的管理与优化

5.1 Kubernetes文件系统概述

5.1.1 Kubernetes中的存储类型与使用场景

Kubernetes支持多种存储类型,包括传统的块存储、文件存储以及对象存储。块存储如AWS的EBS、Azure的Disk和Google的Persistent Disk,通常用于提供高性能、低延迟的存储需求,适合数据库等对性能要求高的应用。文件存储,如NFS、GlusterFS,则通常用于共享文件的场景,适合网站内容、文件共享服务等。对象存储则适合大规模非结构化数据的存储,如归档数据、备份等。

5.1.2 如何选择合适的文件系统

选择文件系统时需考虑数据访问模式、存储需求、成本效益等因素。例如,对于需要频繁读写、并且多个Pod需要同时访问同一数据的场景,NFS和GlusterFS等分布式文件系统可能更合适。如果需要在不同的云平台或数据中心之间进行数据共享,云提供商的特定解决方案可能更适合。

5.1.3 文件系统的性能指标与评估

文件系统的性能评估指标包括但不限于IOPS(每秒I/O操作数)、吞吐量、延迟和可扩展性。评估方法可以包括基准测试、压力测试和分析现有工作负载的I/O模式。对于Kubernetes集群,还需要考虑网络延迟、存储访问速度等对整体性能的影响。

5.2 文件系统的部署与配置

5.2.1 部署支持的文件系统存储解决方案

部署文件系统存储解决方案通常需要配置存储后端以及在Kubernetes集群中创建相应的PersistentVolume (PV) 和PersistentVolumeClaim (PVC)。以NFS为例,你需要先在NFS服务器上配置共享目录,然后在Kubernetes集群中定义PV和PVC。

apiVersion: v1

kind: PersistentVolume

metadata:

name: nfs-pv

spec:

capacity:

storage: 5Gi

accessModes:

- ReadWriteMany

nfs:

path: /nfs/data

server: nfs-server-address

apiVersion: v1

kind: PersistentVolumeClaim

metadata:

name: nfs-pvc

spec:

accessModes:

- ReadWriteMany

resources:

requests:

storage: 5Gi

5.2.2 配置文件系统访问权限和配额

配置文件系统的访问权限通常涉及设置PV/PVC的访问模式、安全上下文以及进行配额限制。例如,使用SELinux标签对NFS挂载点设置适当的权限,以确保Pods安全访问。

apiVersion: v1

kind: Pod

metadata:

name: nfs-pod

spec:

containers:

- name: nfs-container

image: nginx

volumeMounts:

- mountPath: "/mnt/nfs"

name: nfs-volume

volumes:

- name: nfs-volume

persistentVolumeClaim:

claimName: nfs-pvc

5.2.3 验证文件系统的安装和挂载状态

验证文件系统的安装和挂载状态可以通过检查Pod的文件系统来完成。确保挂载点存在,并且Pod可以成功写入和读取数据。

kubectl exec -it nfs-pod -- touch /mnt/nfs/testfile

kubectl exec -it nfs-pod -- ls -l /mnt/nfs/testfile

5.3 文件系统的监控与优化

5.3.1 使用监控工具跟踪文件系统性能

利用监控工具如Prometheus结合Grafana来跟踪文件系统的性能指标。部署这些工具后,配置相应的监控规则和仪表板来展示存储性能数据。

apiVersion: monitoring.coreos.com/v1

kind: PrometheusRule

metadata:

name: file-system-metrics-rules

labels:

role: monitoring

spec:

groups:

- name: file-system-metrics

rules:

- record: file_system_usage

expr: ...

5.3.2 优化文件系统以提升集群性能

优化文件系统可以涉及到调整文件系统的缓存大小、使用顺序写入(如果适用)、关闭文件系统的日志记录等。对于Kubernetes,还可以通过调度策略来优化性能,如将计算密集型Pod放置在高性能存储节点上。

5.3.3 面对大数据场景下的文件系统策略调整

对于处理大量数据的应用,考虑采用高性能、高容量的文件系统解决方案,如Amazon EFS、Azure Files等。同时,也要考虑数据访问模式,合理设置并行读写操作、数据分片以及定期清理无用数据,确保系统稳定运行。

这些章节内容完整地介绍了如何在Kubernetes环境中选择、部署、配置、监控和优化文件系统,以满足不同的业务需求和性能优化目标。

简介:Kubernetes(k8s)是自动化容器化应用部署、扩展和管理的关键平台。本文关注于k8s部署过程中的关键文件,包括”cri-dockerd”容器运行时接口的实现,用于k8s与Docker等容器引擎的通信;”runc.amd64”作为OCI标准的容器执行工具;以及” kube-flannel.yml”文件,用于配置k8s集群内的网络连接。本文将详细阐述这些文件的作用及其在k8s部署中的重要性。

openvela 操作系统专为 AIoT 领域量身定制,以轻量化、标准兼容、安全性和高度可扩展性为核心特点。openvela 以其卓越的技术优势,已成为众多物联网设备和 AI 硬件的技术首选,涵盖了智能手表、运动手环、智能音箱、耳机、智能家居设备以及机器人等多个领域。

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)