群体事件中群体异常行为的检测与量化(DetectingandQuantifyingCrowd-LevelAbnormalBehaviors inCrowdEvents)

人群异常行为(crowd-levelanomalbehaviors,CAB)是导致群体灾难的重要原因,不同于个体异常行为,在局部观察时,CAB通常不会表现出与正常行为的显著差异,并且CAB的规模可能因场景而异为了从视频监控中量化这些CAB的风险水平,本文提出了一种改进的用于CAB检测的人群运动学习框架--多尺度运动一致性网络提出了一种基于双注意力融合的多尺度感知算法(MSMC-Net),我们提出了

摘要

人群异常行为(crowd-levelanomalbehaviors,CAB)是导致群体灾难的重要原因,不同于个体异常行为,在局部观察时,CAB通常不会表现出与正常行为的显著差异,并且CAB的规模可能因场景而异为了从视频监控中量化这些CAB的风险水平,本文提出了一种改进的用于CAB检测的人群运动学习框架--多尺度运动一致性网络提出了一种基于双注意力融合的多尺度感知算法(MSMC-Net),我们提出了一种评估方法,以量化检测到的CAB的风险水平为基础,从我们的MSMC生成的异常评分-风险量化采用在线累积的方式进行,能够反映CAB的风险水平,与其他离线评估指标一致(例如,人群压力),但不提取详细的人群数据在UMN、Hajj和Love Parade三个大规模人群事件数据集上的实验结果表明,MSMC-Net算法的AUC性能分别提高了7.9%、12.2%和29.5%,与现有技术的方法的最佳结果相比,

1、数据集

UMN,Hajj和Love Parade这些数据集被选中,因为它们包含人群水平的异常行为,如人群湍流和逆流,而传统的数据集,如UCSD和上海科技,大多数包含个人-水平异常行为,如打架和突然奔跑。UMN包括步行和逃跑由闭路电视摄像机捕捉在三个野生场景,其中步行被认为是正常的,人群逃跑行为是不正常的。朝觐来源于沙特阿拉伯每年宗教朝圣的监控视频。它捕捉了朝圣者穿过走廊的场景,其中积极标记的异常事件包括行人坐着,跑步,睡觉,和逆流。由于我们关注的是人群级异常,所以我们的测试中只使用了逆流的异常视频。爱游行是基于2010年爱游行人群灾难的监控视频,其中包含了各种高密度的人群级异常行为,如逆流,走走停停的波浪和人群湍流。为了进一步验证我们的方法的鲁棒性,我们还使用MOT 204数据集进行跨数据集评估。选择MOT 20是因为它是一个具有挑战性的数据集,包含一天中不同时间的各种场景中的人群行为,并涵盖具有挑战性的因素,如拥堵,照明变化,在这个数据集中人群的行走方向是复杂和多样的,这使得它具有挑战性,提取运动信息。请注意,由于该数据集仅包含正常人群行为,因此我们仅使用MOT 20来训练我们的MSMC-Net,并在其他三个数据集中测试训练模型的性能(参见crossdataset性能中的相应结果)。在实验中,每个数据集中的正常视频用于训练,正常和异常视频都用于测试。关于如何标记数据集并用于评估的更多细节在补充材料中进行了描述。

2、要解决的问题

2.1 视频异常检测(VAD)存在的问题

近几十年来,视频异常检测(VAD)类公开数据集的广泛性,大多数方法都是针对个人级别的异常行为(如突然奔跑、打架和偷窃)进行设计和验证的。然而,据我们所知,用于检测人群级别异常行为的VAD仍然非常有限。为了防止人群级别交互中发生的潜在风险和灾难,针对大型公共活动中交通事故的检测问题,设计有效的VAD方法具有重要意义。

由于个体水平和人群水平之间的内在差异,直接应用现有的VAD方法检测交通事故是具有挑战性的。层次行为。首先,群体行为模式出现在宏观层次的群体运动中[4]。与个体层次行为不同异常可以通过异常个体在人群局部区域中的出现或运动来区分,当在局部观察时,人群水平异常并不总是表现出与正常异常的显著差异因此,现有的VAD模型,其主要被设计为通过学习与局部外观相关的特征来区分异常模式,(例如,提升臂)或局部运动其次,与通常具有相对统一尺度的个体级行为相比,群体级行为和时空模式的尺度在不同场景下可能变化更大[11因此,针对CAB的变化的尺度和变化的时空模式的VAD模型的开发对于确保CAB检测的鲁棒性能是至关重要的。

2.2 视频异常检测

鉴于人群视频中异常行为的模糊性和多样性,当前VAD研究的主流是数据驱动方法,该方法仅使用正常数据在训练阶段学习正常行为模式,并通过评估与正常模式的偏差在测试阶段检测异常行为。大多数现有的深度学习方法都属于基于重建的或基于预测的,其中经常具有高重建或预测误差的测试样本被视为异常。最近,添加视频级异常标签数据用于训练的弱监督方法也获得了普及。在这项工作中,我们采用无监督学习方法来检测CAB。由于人群级别的异常行为发生频率较低,因此不考虑弱监督学习方法(通常在人群灾难期间)比个人级别的异常,因此人群异常数据太稀少而不能充分用于训练。在最近的无监督VAD方法中[,一致性的概念已经被考虑用于异常检测。然而,它们的一致性建模主要用于捕获个体水平的相关模式(例如,检测到的对象的外观和运动之间的一致性)。相比之下,我们的工作利用了群体运动的全局时空一致性,并考虑了群体水平异常行为所特有的多尺度问题。

2.3 人群行为分析

然而,由于数据的稀缺,对人群灾难中人群行为的分析仍然非常有限。基于2006年朝觐灾难视频,局部密度,局部速度,和人群压力进行测量,以分析从正常人群到走走停停波和人群湍流的过渡[3]从Love Parade 2010灾难视频中提取的光流直方图用于聚类运动模式,结合光流运动的幅度和标准差来评估群体湍流中的冲击波[28]引入条纹流和人群聚集性度量来揭示人群运动的动力学和结构特性[29]。然后将人群中条纹流的加速度分析成功地用于异常行为检测[30]。。使用提取的轨迹,基于行人运动的基于距离和点过程表示来分析Love Parade踩踏事件中的时间模式[31]。上述方法中使用的测量可以捕获异常行为模式的某些方面。例如,光流幅值的高标准差用于反映由于推压而导致的移动的人和不移动的人在人群湍流中的共存[28]。然而,其他正常情况(例如,访问市场)也可能显示出速度的高变化。因此,用于评估异常的某些特征的这种测量难以捕获足以将CAB与所有正常行为区分开的全部行为模式。在我们的工作中,我们利用图卷积网络(GCN)的细粒度特征学习能力来全面捕获人群运动中的相关模式,以有效区分CAB和正常CAB。

3、提出的创新点

3.1 针对VAD提出的方法

为了解决前面提到的CAB检测的挑战,我们的工作有以下两个显著的特点:首先,不同于传统的VAD方法检测局部异常,我们提倡分析集体人群运动的全局模式来区分CAB和正常行为。为此,我们考虑了人群运动一致性建模,这是一个量化人群集体性的信息特征。针对CAB检测任务,本文提出了一种基于图的人群运动一致性表示方法,该方法基于视频中提取的光流信息,同时捕捉人群运动的空间和时变特征。其次,为了使检测对CAB的尺度变化具有鲁棒性,本文设计了一种新颖的人群运动学习框架,该方法从不同尺度下的特征图中提取出丰富的人群行为信息进行模式识别,并引入双注意解码器有效地合成多尺度特征图,用于不同场景下的人群行为自适应检测.

3.2 采用的方法

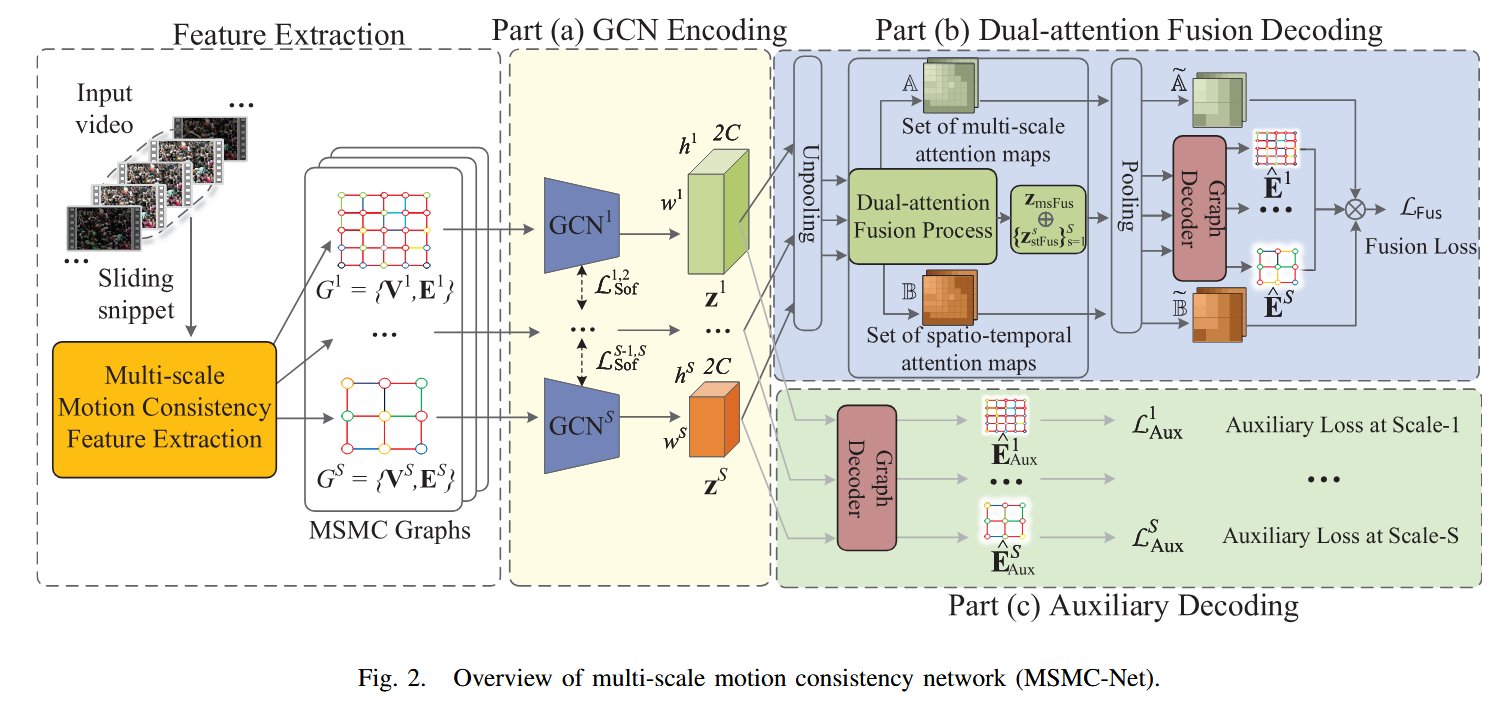

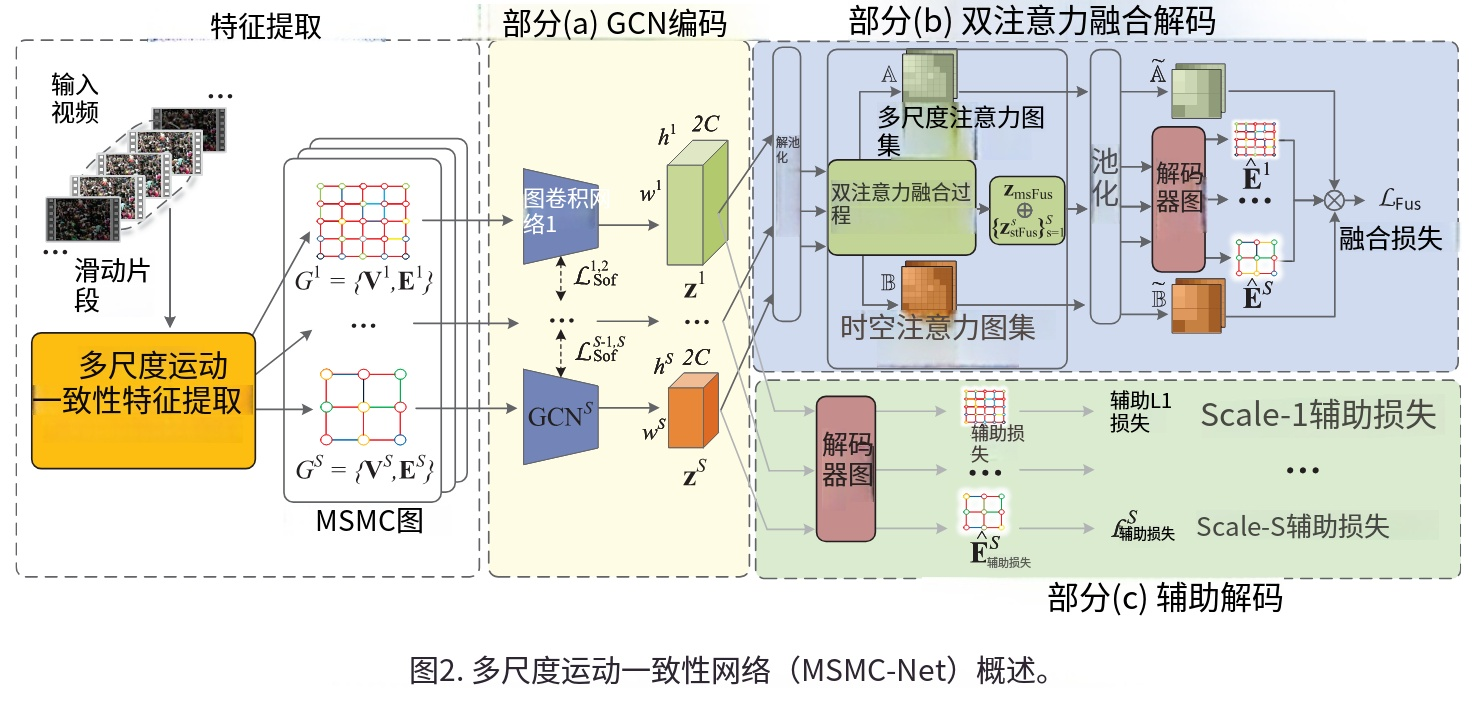

提出的多尺度运动一致性网络,表示为MSMC-Net。如图2所示,它首先将连续光流场作为人群运动一致性特征提取模块的输入,以形成多尺度特征图。然后,图由GCN编码,然后是图解码模块,该模块通过基于注意力的无监督学习来学习异常分数。我们还介绍了一个辅助解码模块,有效提高多尺度特征编码质量。

3.2.1 人群运动一致性表示

为了有效地捕获与人群级别异常行为相关的模式,提出了一种新的测量人群运动一致性的方法,该方法将人群空间划分为多个区域,并测量区域内和区域之间的空间和时间运动一致性,在一个时间框架和多个时间框架中。在本节中,我们首先介绍了我们测量空间和时间人群运动一致性的方法。然后,我们介绍了一种基于图的表示,它包含多个尺度下的空间和时间一致性特征。

1)我们提出用空间内一致性(sp)来度量一个区域内的均匀程度,用空间间一致性(0 sp)来度量相邻两个区域平均速度的相似性,用空间内一致性来捕捉内部的无序,一个人的世界帧间一致性用于评估相邻区域之间的关系。例如,反向流中的两个相对人群可以产生最低的空间-帧间一致性[38]。

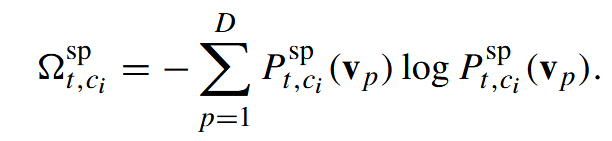

利用区域内的空间速度熵计算空间-内部一致性,并根据区域内的光流矢量,将矢量方向空间离散为D类:{v1,v2,.,vD},诸如上、下、左、右等H sp t,CI(VP)用来表示在帧t的区域ci处方向属于vp的光流矢量的数目,可以通过Psp来计算在帧t的区域ci处的光流矢量的分布概率t,ci(vp)= Hsp t,ci(vp)/n,其中n是帧t的区域ci处的像素级光流矢量的总数。帧t的区域ci处的空间内部一致性可以计算如下:

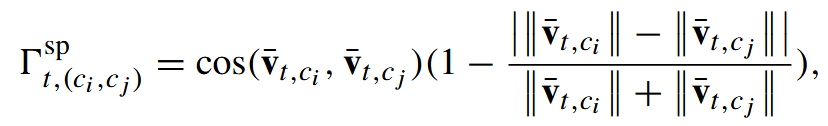

对于空间-帧间一致性,基于调整后的余弦相似性来测量两个区域的平均速度的差异,该余弦相似性测量矢量的角度差异和绝对值差异。

其中ci和cj是两个相邻区域,并且v t、ci、v t、cj是它们在帧t处的平均速度。

2)与空间一致性相似,我们提出了时间-内部一致性(tp)和时间-内部一致性(0 tp),前者用来度量一个区域的平均速度随时间变化的均匀程度,后者用来度量两个相邻区域的平均速度随时间变化的均匀程度,时间一致性弥补了空间一致性的不足,以获得时变特征。时间-内部一致性可以帮助检测人群湍流开始时随时间的频繁速度变化[3],[5]。时间-内部一致性可以捕获湍流区域中行人随时间的同步运动[39]。

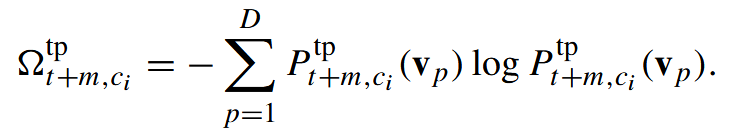

基于从第t帧开始的片段的平均速度场序列,计算时间速度熵来度量时间-内部一致性,类似于空间-内部一致性的计算,将平均速度分为D类,Htp t+m,ci(vp)度量次数,其中在帧t到t + m期间,区域ci的平均速度的方向属于vp。在此期间的速度分布概率可由下式计算:Ptp t+m,ci(vp)= Htp t+m,ci(vp)/m,其中m是片段的长度,帧t的区域ci处的时间速度熵计算如下:

为了度量两个区域之间的时间-内部一致性,我们使用互信息的概念来描述两个区域运动随时间的相关性,给出了两个相邻区域的速度分布概率Ptp t+m,ci(vp),Ptp t+m,cj(vq)及其联合分布概率Ptp t+m(vp,从帧t到帧t + m的区域ci和cj之间的时间-帧间一致性可以计算如下:

![]()

3)运动一致性图的构建:为了表征帧t的人群运动一致性,使用帧t的空间一致性特征和以帧t结尾的片段的时间一致性特征。提出了一种捕获帧t的空间和时间一致性信息的图结构,如下所示:Gt = {Vt,Et },其中帧中的每个划分区域被认为是顶点,相邻区域通过边连接,并且Vt和Et表示帧t处的顶点和边的集合,区域ci的每个顶点包含向量形式的空间内部一致性和时间内部一致性的信息:

![]()

连接两个相邻区域ci和c j的边的权重以向量的形式包含空间-帧间一致性和时间-帧间一致性的信息:

![]()

对于给定的视频,生成运动一致性图的序列,其中第一图Gm是基于从帧1到帧m的第一滑动片段来构造的。每当滑动片段的窗口滑动τ帧时,生成后续图。

3.2.2 多尺度运动一致性网络

基于上述MSMC图的构造,我们的目标是在适当的尺度水平下学习正常人群的行为模式,以便通过检查与正常模式的偏差来检测人群级别的异常行为。为此,我们提出了我们的MSMC网络,在训练中执行基于MSMC图的多尺度融合重构,并在测试中执行基于重构的异常检测。

1)网络架构:图2示出了我们提出的人群运动学习框架,其包括(a)GCN编码、(B)多尺度融合解码和(c)辅助解码。部分(a)接收从输入视频提取的MSMC图,基于GCN的编码器用于利用这些图中的结构特征来捕获人群运动中的相关性。尺度嵌入向量。为了解决人群行为的尺度变化和时空变化问题,部分(B)将多尺度嵌入向量通过双注意融合模块融合成融合向量,然后进行基于融合的解码来重建MSMC图。为了防止基于融合的重建陷入局部最优,部分(c)介绍了辅助解码过程,其在训练期间分别在每个尺度上重建MSMC图。

如图2的部分(a)所示,从给定滑动片段提取的MSMC图{Gs}S s=1被编码为多尺度嵌入向量{zs}S s=1。由于MSMC图中的边被表示为包含空间和时间一致性信息的二维向量,我们采用两个GCN对每个图进行编码。一个GCN仅使用边的空间特征来聚合节点的空间和时间特征,另一种只利用边的时间特征,将两个GCN的嵌入向量连接起来,得到每个尺度s下的图嵌入向量zs ∈ Rws×hs×2C,其中ws × hs等于尺度s的运动一致性图中的顶点的数量,并且C是编码器的嵌入维度。多维边问题的GCN算法实现简单,可以对每个维度单独调整GCN参数,对于不同尺度之间的知识共享,将重构任务视为多任务操作,并在两个不同尺度上的编码器之间施加软共享约束(Ls 1,s2 Sof)。

如图2的部分(B)所示,该方法首先通过最近邻解池将多尺度向量的维数统一起来,然后利用基于自注意的双注意机制生成表示不同尺度和空间权重的多尺度注意图,时间注意力图表示空间和时间注意力的相对重要性,用于表征给定的人群行为。该方法首先基于注意力图对整形后的注意力向量进行融合,生成融合向量zmsFus和{zsstFus}S s=1,然后通过池化和图解码,将融合向量重构为MSMC图,并结合多尺度注意力图、时空注意力图和重建损失来评估基于双注意融合过程的重建。

如图2的部分(c)所示,仅使用从部分(a)获得的对应尺度的嵌入向量来在每个尺度下重构MSMC图。解码器接收每个尺度s的嵌入向量zs该辅助重建任务有助于防止部分(B)中的基于融合的重建过程。这是因为如果仅使用融合损失来执行尺度选择和重构学习两者,在尺度选择中优选的尺度将更有利于重构学习。这可能导致在特定尺度下的优化过多。因此,在部分(c)中使用辅助损失(Ls Aux)分别学习每个尺度下的重建,以防止忽略最初表现不佳的某些尺度。

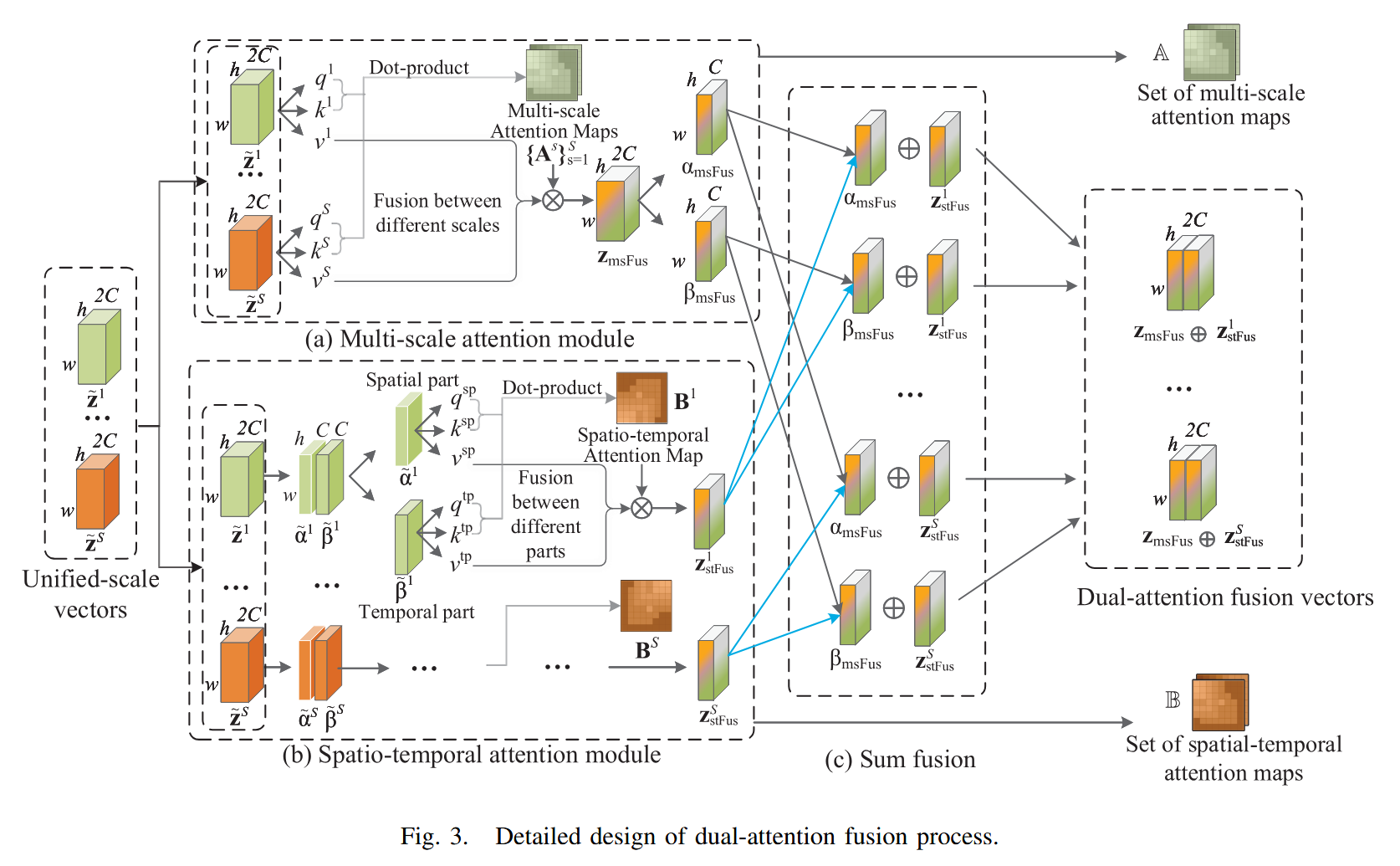

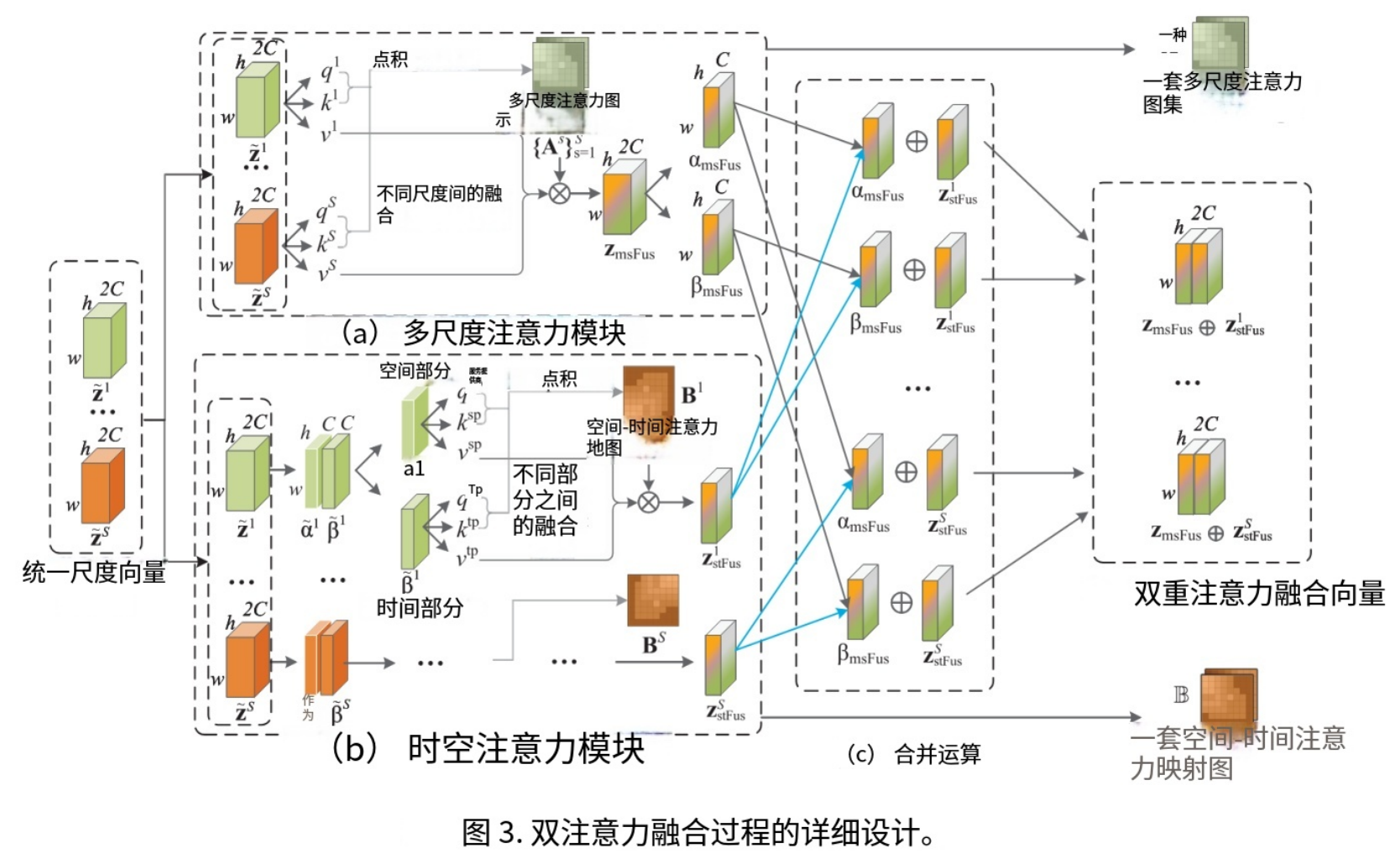

2)双注意力融合过程:在不同的人群场景中,人群行为的规模和时空模式会发生变化,影响人群行为的识别和人群级别异常的检测。图3显示了我们提出的双注意力融合模块,用于自适应学习不同场景下人群行为的规模和时空变化。该过程包括三个模块:(a)多尺度注意模块,(B)时空注意模块,以及(c)总和融合模块。

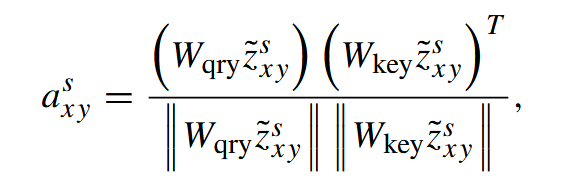

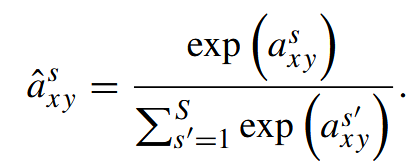

在模块(a)中,生成的查询(qs = ∑ w,h x,y = 1,1 Wqryz sxy),key(ks = ∑ w,h x,y = 1,1 Wkeyz <$sx y),以及值(vs = ∑ w,h x,y = 1,1 Wvalz sxy)从统一尺度向量z s获得尺度s的信息。所生成的查询(qs)和关键字(ks)用于指导按比例的注意力图的生成。位置x,y处的比例s的多比例注意力图axs,y计算如下:

其中s ∈ {1,2,.,S},x ∈ {1,2,.,w},y ∈ {1,2,.,h},n·k表示范数函数,Wqry,Wkey是用于生成查询的可训练权重矩阵(qxsy = Wqryz sxy)和key(ksxy = Wkeyz sxy)。它可以进一步归一化以表示尺度的当前相对重要性:

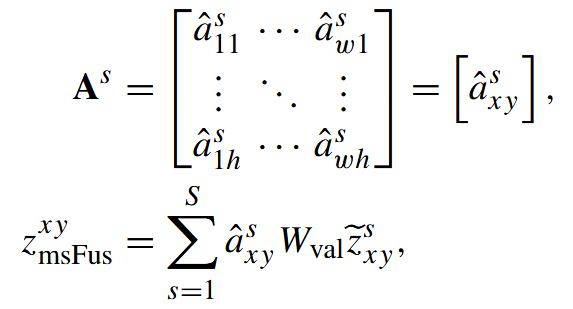

所有尺度A = {As}S s=1的归一化多尺度注意力图的集合可以用作多尺度融合向量的权重:

其中Wval是用于生成值的可训练权重矩阵模块(a)的输出是归一化的多尺度注意力图A的集合和多尺度融合向量zmsFus ∈ Rw×h×2C = [z x y msFus ]。然后,多尺度融合向量在编码器的嵌入维度上被均匀地分成两部分,表示空间向量αmsFus ∈ Rw×h×C和时间向量βmsFus ∈ Rw×h×C,以便执行后续融合。

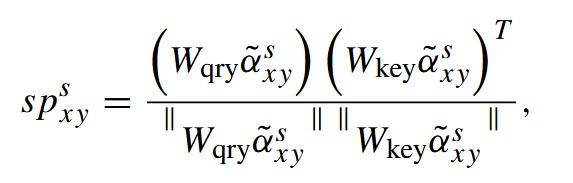

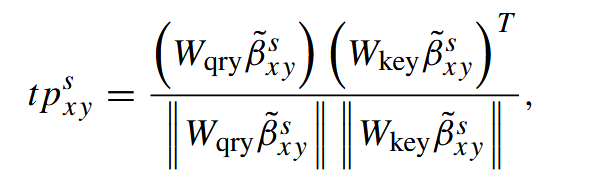

在模块(B)中,考虑统一尺度嵌入向量{z ∈ s}S s=1是从空间和时间部分级联的,所述空间和时间部分从{Es = [0 sp;首先将嵌入向量分成表示空间向量{α s}S s=1和时间向量{β s}S s=1的两个部分,然后,类似于模块(a),所生成的空间部分的查询(qsp)和关键字(ksp)以及时间部分的查询(qtp)和关键字(ktp)用于指导时空注意力图的生成。

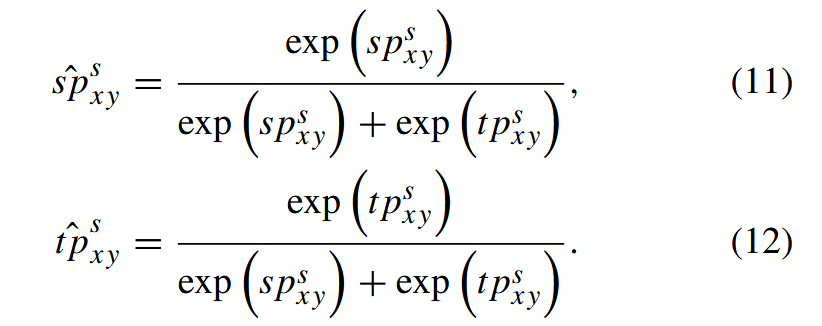

其中s ∈ {1,2,.,S},x ∈ {1,2,.,w},y ∈ {1,2,.,h}。上述可以进一步归一化以表示空间和时间部分的当前相对重要性:

归一化的时空注意力图的集合B = {Bs }S s=1可以用作时空融合向量的权重:

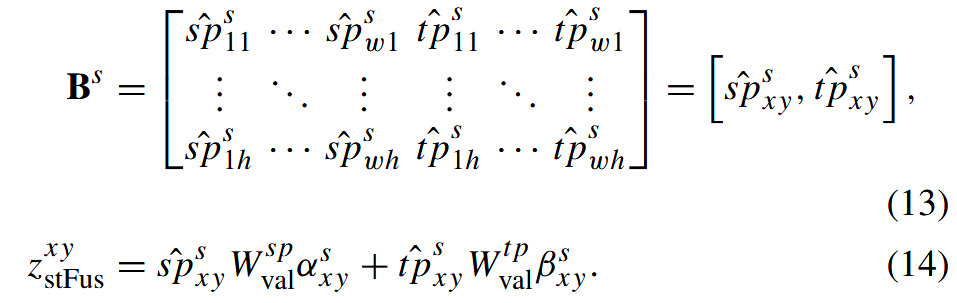

其中W sp val和W tp val是用于在位置x,y处生成尺度s的值的可训练权重矩阵(vsp xy = Wsp瓦尔α sx y,vt p xy = Wtp瓦尔β xsy)。模块(b)的输出是归一化时空注意力图B的集合和时空融合向量{zs stFus = [z x y stFus ] }S s=1。

在模块(c)中,进一步融合由两个注意力模块生成的多尺度融合向量zmsFus和时空融合向量{zs stFus}S s=1,并用于重构MSMC图。将时空融合向量与多个像素的空间向量αmsFus逐元素求和,尺度融合向量作为该尺度下最终融合向量的空间部分。类似地,将多尺度融合向量的时间向量βmsFus与时空融合向量相加以形成最终融合向量的时间部分。然后,因此,模块(c)的输出是双注意力融合向量{zmsFus | zsstFus}S s=1,其中zmsFus | zsstFus}代表逐元素求和运算。

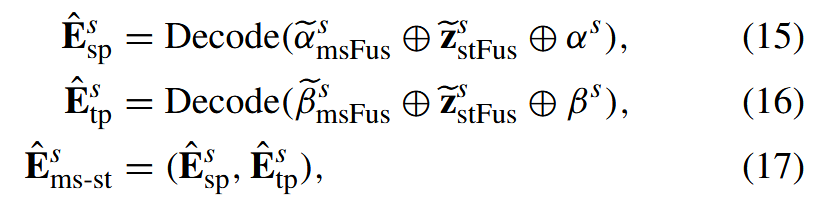

双注意力融合过程完成后,将多尺度融合向量zmsFus、时空融合向量{zs stFus}S s=1和归一化注意力图A、B通过池化层重新整形为原始尺度,最后以点积方式重构尺度s的空间边缘E ssp和时间边缘E tsp,可以表示为:

其中,m表示逐元素求和运算,α s msFus和β s msFus表示从针对尺度s的整形多尺度融合向量m msFus分离的空间部分和时间部分,αs和βs表示与尺度s的嵌入向量zs分离的空间部分和时间部分。1表示各尺度的重要性,{B_S_s}S_s=1表示重构的MSMC图中各边的空间和时间部分的重要性,然后将这些重构后的图用于多尺度融合损失的聚合.

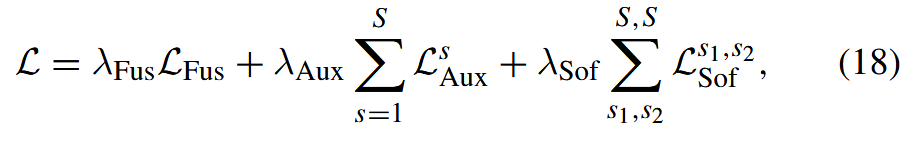

3)损失函数:在训练阶段,通过最小化以下目标函数来优化MSMC-Net,该目标函数由融合损耗LFus、辅助损耗LAux和软共享损耗LSof组成。

其中超参数λFus、λSof、λAux用于调整每个部分的重要性。

4)基于融合的异常评分:在测试阶段,给定学习到的人群运动的正态相关模式,通过检查与这些正态相关模式的偏差来检测异常。由于在训练阶段已经学习了人群行为的尺度,因此在测试阶段仅使用多尺度融合损失LFus来检测异常。考虑到人群级别的异常行为往往会持续一段时间,采用移动平均,得到每帧t的异常分数St,如下:

![]()

其中,λMov是移动平均的权重,N(·)表示最小-最大归一化,St-1是前一帧中的异常分数,并且S 0 = N(LFus)。异常分数在0到1的范围内,并且该分数更接近1指示更高程度的异常。

3.2.3 定量检测到的CAB的风险水平

为了支持对人群风险的在线评估,我们引入了一个定量评估方法,从我们的MSMC生成的异常评分中得出检测到的CAB的风险级别-用于生成异常分数的我们的MSMC-Net的主要输入仅是从人群视频中提取的光流场,并且使用该方法提取两个连续帧的光流需要大约120 ms。从我们训练的MSMC-Net生成异常分数的平均运行时间需要大约75 ms(参见我们的实验)。通过使用异常评分作为推导CAB的风险级别的基础,可以确保时间效率。

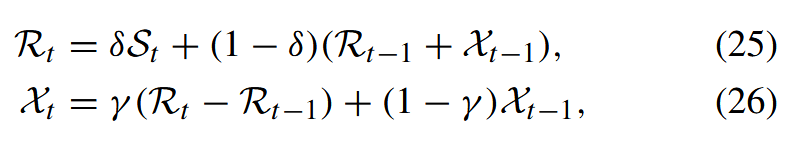

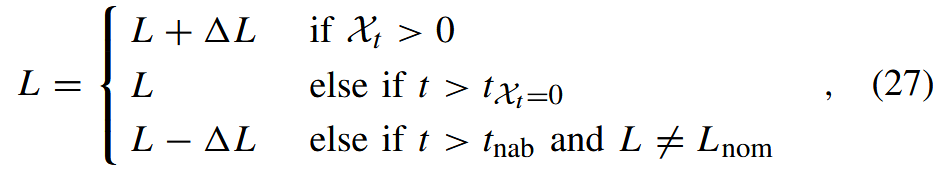

为了解释上述异常评分和人群风险水平之间的差异,我们采用基于双指数加权平滑的累积时间平滑方法来推导检测到的CAB的风险水平。双指数平滑是时间序列数据的平滑方法,其中涉及两个关键术语:水平项和趋势项。水平项捕获时间序列数据在一段时间内的值的平滑估计,而趋势项捕获时间序列数据在一段时间内的平均值增长的平滑估计。有了这两个项,双指数平滑可以通过考虑给定时间序列数据中的短期波动和长期趋势来提供稳健的数据平滑。具体来说,为了推导人群视频的给定帧t中人群行为的风险水平,我们首先获得异常分数的时间序列[St-L +1,St-L +2,.,St-1,St ],其中L是序列的长度。然后,帧t处的风险水平Rt估计如下:

其中Rt是帧t处的水平项,Xt是帧t处的趋势项,0 < δ,γ < 1,并且R1 = S1,X1 = S2-S1。水平项是当前值与先前水平项和趋势项的累积的加权和。它可以帮助减少异常分数随时间的波动。趋势项衡量异常分数的加权值增长。它对于恰好在检测到人群级别异常行为之前平滑风险级别转换是有用的。

为了支持对人群行为风险水平的连续评估,使用了滑动窗口方法。这里,窗口大小为L,当监控视频在t + 1处进入下一视频帧时,窗口滑动一个时间单位。然后根据滑动窗口内的异常分数序列推导出相应的Rt+1。然而,由于不同人群级别异常行为的持续时间在不同场景中可能会有很大变化,因此固定大小的滑动窗口不足以适应不同CAB的异常分数的不同时间特性。因此,我们引入了一种自适应滑动窗口调整策略,根据异常分数的增长率来调整滑动窗口的大小。

具体地,在检测到CAB之前(即,在正常情况下),滑动窗口大小L被设置为固定值Lnom。一旦检测到CAB,L被动态更新如下:

其中,IL是L的单位更新步长并被设置为1,Xt是我们的数据平滑中的趋势项,其指示滑动窗口内的异常分数S的平均增长率,tXt =0是Xt达到零的时间,并且tnab表示根据我们的MSMC-Net的输出,人群返回到正常行为的时间。我们调整策略的基本原理是,在检测到CAB后,当异常分数呈增长趋势时,增加滑动窗口的大小。一旦异常分数的平均增长率达到零,表示异常分值已接近峰值,开始稳定或下降,此时滑动窗口不再增加,异常行为结束后(即,t > tnab),滑动窗口的大小减小,直到其达到Lnom。

4、结论和不足

引入无监督学习方法来执行人群级别的异常检测,其通过多尺度时空运动一致性学习来利用人群运动的宏观模式。提出了一种基于双注意机制的多尺度运动一致性网络,用于学习在多尺度上提取的人群运动特征,并利用运动一致性网络的时间和空间特征提取群体运动的全局和集体模式。规模和使我们的模型能够估计检测CAB的人群行为的适当规模。此外,为了量化检测到的CAB的风险水平,我们提出一种评估方法,通过优化异常检测网络中的异常得分来获得CAB的风险级别。量化的风险级别可以帮助安全人员实时了解检测到的CAB的严重性。基于真实的-实验结果表明,该检测网络的检测性能优于现有的VAD检测方法,可应用于跨数据集的检测,对噪声具有较强的鲁棒性。风险评估实验结果表明,该评估方法可以生成与现有离线度量一致的量化风险等级,并且具有较低的运行时间,可以支持在线风险监测。由于人群的复杂性,该方法具有较强的鲁棒性,可以有效地提高网络的安全性。由于我们目前的方法只能实现帧级异常行为检测,未来我们将致力于通过融合深度学习模型和基于物理信息的人群模型来改进现有框架,以支持CAB的像素级检测。

openvela 操作系统专为 AIoT 领域量身定制,以轻量化、标准兼容、安全性和高度可扩展性为核心特点。openvela 以其卓越的技术优势,已成为众多物联网设备和 AI 硬件的技术首选,涵盖了智能手表、运动手环、智能音箱、耳机、智能家居设备以及机器人等多个领域。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)